Technisches SEO

Technische Suchmaschinenoptimierung verständlich erklärt

Technisches SEO (auch Technical SEO) ist ein Teilbereich der Suchmaschinenoptimierung und schafft die Basis dafür, dass Suchmaschinen eine Website zuverlässig crawlen und indexieren können. Dazu gehören neben einem sauberen und schmalen Quellcode etwa eine optimierte Seitenarchitektur sowie eine optimierte Darstellung auf Mobilgeräten mit unterschiedlichen Bildschirmgrößen. Technisches SEO allein garantiert keine Top-Platzierungen, bildet jedoch das Fundament für stabile Rankings. Es schafft die Grundlage für die Wirksamkeit weiterer Maßnahmen der OnPage- sowie Offpage-Optimierung und trägt zur Verbesserung der Nutzererfahrung bei.

Die wichtigsten Aspekte von technischem SEO zusammengefasst:

- Der technische Zustand einer Webseite kann ihre Rankings und Sichtbarkeit beeinflussen.

- Technisches SEO bildet daher das Fundament für die Wirksamkeit weiterer Onpage-Maßnahmen und unterstützt den Erfolg Deiner SEO-Strategie.

- Damit eine Webseite in Suchmaschinen ranken kann, müssen ihre Inhalte für den Crawler zugänglich sein und eine saubere Indexierung ermöglichen.

- Eine hierarchisch gegliederte, logische und einfache Seitenarchitektur erleichtert es Nutzern und Suchmaschinen, sich auf der Webseite zurechtzufinden.

- Auch das Vermeiden doppelter Inhalte zählt zu den wichtigen Aufgaben der technischen Suchmaschinenoptimierung.

Die wichtigsten Maßnahmen im technischen SEO

1. Optimiere die Kategorie- und URL-Struktur

Sprechende URLs mit klaren Bezeichnungen vermitteln Besuchern sofort, welchen Inhalt sie auf der Seite erwarten können. Eine hierarchisch und thematisch gegliederte URL- und Verzeichnisstruktur hilft zudem auch Suchmaschinen wie Google, den Aufbau von Webseiten und ihrer Inhalte zu verstehen. Daher solltest Du bei der Gestaltung Deiner URLs ein paar Grundregeln einhalten:

- Gestalte die URLs sprechend, sodass sie den Seiteninhalt prägnant beschreiben.

- Verzichte auf Umlaute und Sonderzeichen wie „ß“. Nutze stattdessen klare, standardisierte Schreibweisen, um Probleme bei der URL-Codierung zu vermeiden.

- Trenne Wörter nicht mit einem Unterstrich, sondern mit einem Bindestrich, und halte die URLs möglichst kurz.

- Verwende das Hauptkeyword der jeweiligen Seite, verzichte auf Keyword-Stuffing.

- Bilde die Kategoriestruktur der Webseite und Hierarchie der Inhalte auch auf URL-Ebene ab, damit Benutzer und Suchmaschinen den Kontext der Seite besser verstehen. Mehr dazu erfährst Du in unserem Beitrag zur Informationsarchitektur.

Wähle zudem eine logische Seitenstruktur, die eine intuitive Navigation mit kurzen Wegen ermöglicht. Idealerweise ist jede relevante Seite mit maximal 2 bis 3 Klicks von der Startseite aus erreichbar. Kurze Klickwege helfen Nutzern, Crawlern und KI-Systemen, Inhalte schneller zu finden und zu indexieren.

Beispiel für eine optimierte URL

Ein Beispiel für eine kurze, prägnante und sprechende URL inklusive Keyword ist etwa:

- https://digitaleffects.de/seo-strategie/seo-kpi/

Sowohl Nutzer als auch Google erkennen sofort, dass es im Inhalt der Seite um KPIs im Kontext einer SEO-Strategie geht.

2. Vermeide Duplicate Content

Taucht derselbe oder fast identischer Inhalt auf mehreren Seiten auf, spricht man von Duplicate Content, also doppelten Inhalten. Diese können die Sichtbarkeit und das Suchmaschinenranking von Webseiten verschlechtern. Suchmaschinen können dann schwer entscheiden, welche Seitenvariante die höchste Relevanz für eine Suchanfrage besitzt. Häufig wählt Google dann (temporär) eine Variante aus, während andere an Sichtbarkeit verlieren.

Dies führt oft dazu, dass Google ähnliche Seiten abwechselnd testet, was die Rankings destabilisiert. Man spricht hierbei von einer Keyword-Kannibalisierung. Stelle daher sicher, dass pro Suchintention nur eine indexierbare Zielseite existiert.

Duplicate Content kann verschiedene Ursachen haben:

- Etwa dann, wenn ein Produkt oder eine Unterkategorie über verschiedene Kategoriepfade erreichbar ist und dabei für jeden Pfad eine neue URL entsteht.

- Neben Filter-URLs und verschiedenen URL-Varianten, die Du mithilfe des Canonical Tags als Duplikate auszeichnen kannst, kann auch eine fehlerhafte Seitenarchitektur für Probleme mit Duplicate Content sorgen.

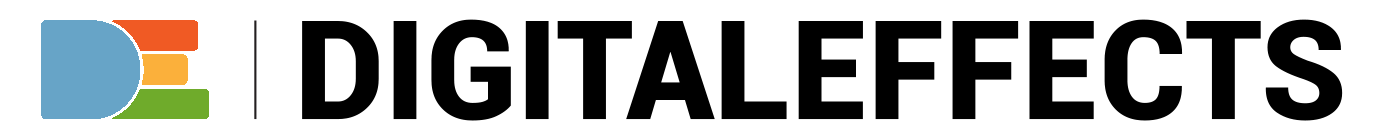

Häufiges Beispiel für die Entstehung von doppelten Inhalten in Onlineshops

Ein Onlineshop für Schuhe führt sowohl die Unterkategorie „Nike + Sneaker“ als auch „Sneaker + Nike“. Dadurch entstehen doppelte Kategorien.

Dieses Problem kannst Du lösen, indem Du nur eine indexierbare Variante für den jeweiligen Inhalt anlegst. Zudem sollte auch nur diese Seitenvariante intern verlinkt werden. Doppelte Kategorien und Produktseiten solltest Du unbedingt vermeiden.

Ist dies nicht möglich, kannst Du Google mit dem Canonical Tag mitteilen, dass die Hauptvariante des Inhalts unter einer anderen URL zu finden ist:

- <link rel=“canonical“ href=“https://www.seite.de/hauptvariante-des-inhalts/“/>

Werden die doppelten Varianten hingegen durch Filter oder Suchfunktionen erzeugt, ist es meist ratsam, statt des Canonical Tags den Robots-Meta-Tag zu verwenden. Mit der Anweisung “noindex” wird die Seitenvariante dann von der Indexierung ausgeschlossen:

- <meta name=“robots“ content=“noindex“>

Übrigens: Auch URLs mit unterschiedlichen Inhalten können miteinander um Rankings konkurrieren, wenn Du mehrere Seiten zu synonymen Keywords anlegst. Achte daher bei der Keyword-Recherche darauf, dass Du Synonyme gruppierst und nur zur Optimierung einer einzigen Seite verwendest.

Gratis SEO-Strategie Session sichern

1. Session

anfragen

2. Roadmap

erhalten

3.Marktanteile

erobern

Frage jetzt Deine persönliche Strategie-Session in einem 1-on-1-Videocall mit Christian B. Schmidt an. Statt allgemeiner „SEO-Tipps“ bekommst Du Deine individuelle Challenger Roadmap, um neue Marktanteile zu erobern.

Limitiert auf 10 Sessions pro Monat und nur für Hidden Champions mit Wachstumszielen.

3. Robots.txt: Steuere das Crawling der Webseite

Damit eine Seite ranken kann, müssen ihre Inhalte zunächst von Suchmaschinen-Robots aufgerufen und untersucht (gecrawlt) werden. Ein verbreiteter Fehler, der oft im Kontext eines Launches oder Relaunches von Webseiten auftritt, ist eine falsch konfigurierte robots.txt-Datei. Hierin werden unter anderem die Zugangsberechtigungen für Suchmaschinenbots geregelt. Mithilfe der robots.txt-Datei steuerst Du den Zugriff der Crawler und kannst bei Bedarf verhindern, dass bestimmte Bereiche gecrawlt werden – etwa die Testumgebung einer Seite oder der Warenkorb-Bereich eines Onlineshops.

Relevante Inhalte, die in den Suchergebnissen ranken sollen, sollten jedoch jederzeit für den Crawler abrufbar sein. Daher ist die Überwachung der robots.txt ein wichtiger Bestandteil von technischem SEO, insbesondere nach einem Relaunch. Denn oft wird die Anpassung der Datei nach dem Livegang schlicht vergessen, was die Indexierung beeinträchtigt und Dich Sichtbarkeit und Traffic kosten kann.

Die robots.txt besteht immer aus zwei Elementen:

- User-Agent: der Bot oder Crawler, an den sich der Befehl richtet

- Befehl: „Disallow: /“ sperrt betroffene Pfade fürs Crawling, „Allow: /“ erlaubt betroffene Pfade

Beispiel 1:

User-agent: Googlebot

Disallow: /was-ist-crawling/

Der User-Agent „Googlebot“ darf den Ordner deine-domain.de/was-ist-crawling/ und alle Unterverzeichnisse nicht crawlen.

Beispiel 2:

User-agent: *

Allow: /

Alle Crawler dürfen auf die gesamte Webseite zugreifen. Da dies dem Standardverhalten der Crawler entspricht, ist dieser Eintrag nicht zwingend erforderlich.

Für gewöhnlich kannst Du die robots.txt einfach über den Browser aufrufen, indem Du die Domain und dahinter /robots.txt einträgst.

- Beispiel: www.deine-domain.de/robots.txt

Was ist Crawling und wie kann ich dafür optimieren?

Unter Crawling versteht man den Prozess, bei dem Suchmaschinen-Bots (wie der Googlebot) das Internet nach neuen oder aktualisierten Inhalten durchsuchen. Der Bot folgt dabei Links von einer Seite zur nächsten und analysiert den Quellcode.

Um das Crawling zu optimieren und das begrenzte Crawl-Budget effizient zu nutzen, sollten folgende Punkte beachtet werden:

- Interne Verlinkung stärken: Vermeide verwaiste Seiten ohne interne Links.

- Flache Hierarchien: Jede relevante Seite sollte mit maximal 2 bis 3 Klicks erreichbar sein.

- Server-Antwortzeiten minimieren: Ein schneller Server ermöglicht dem Bot, mehr Seiten in kürzerer Zeit zu erfassen.

- Fehlerquellen prüfen: Behebe 404-Fehler und vermeide lange Weiterleitungsketten.

4. Stelle die Indexierbarkeit relevanter Inhalte sicher

Zusätzlich solltest Du die Robots-Meta-Tags Deiner Inhalte prüfen. Diese befinden sich im Quellcode und können unterschiedliche Direktiven enthalten, zum Beispiel „noindex“.

Für relevante Inhalte gilt in der Regel:

- <meta name=“robots“ content=“index, follow“>

Diese Anweisung muss jedoch meist nicht explizit gesetzt werden, da sie dem Standardverhalten von Crawlern entspricht. Möchtest Du hingegen vermeiden, dass ein Inhalt indexiert wird, kannst Du den folgenden Tag verwenden:

- <meta name=“robots“ content=“noindex, follow“>

Möchtest Du zusätzlich verhindern, dass der Robot den Links auf der Seite folgt, lautet die Direktive wie folgt:

- <meta name=“robots“ content=“noindex, nofollow“>

Tipp: “noindex” und “disallow” nicht gemeinsam verwenden

Schließe Inhalte nie per Robots-Meta-Tag von der Indexierung und gleichzeitig per robots.txt vom Crawling aus.

Der Disallow-Befehl der robots.txt hingegen versperrt Google den Zutritt zur Seite. Die Suchmaschine kann also auch den Befehl “noindex” nicht mehr lesen und die Seite bleibt im Index, ohne dass Änderungen am Inhalt in den Index übernommen werden.

Soll ein zuvor indexierter Inhalt nicht mehr in den Suchergebnissen erscheinen, etwa weil ein Produkt eines Onlineshops nicht mehr angeboten wird, nutze immer die Noindex-Direktive. Sie teilt Google mit, dass die Seite nicht mehr in den Suchergebnisseiten (SERPs) angezeigt werden soll.

5. Prüfe die Canonical Tags

Häufig entstehen mehrere Varianten einer URL, etwa durch Parameter, Filter, Seitenvarianten mit und ohne „www“ oder Unterschiede in Groß- und Kleinschreibung. Das stellt Google vor die Aufgabe, eine Variante für die Indexierung zu bestimmen. Das kann zu schlechteren Rankings führen, da die Duplikate möglicherweise zueinander in Konkurrenz treten.

Um Google mitzuteilen, welche URL die Hauptvariante ist, kannst Du den Canonical Tag verwenden:

- <link rel=“canonical“ href=“https://deine-domain.de/hauptvariante-deiner-url/“ />

Binde diesen im <head> jeder Duplikatseite ein. Idealerweise verweist auch die Hauptseite per Self-Referencing-Canonical auf sich selbst.

Beachte jedoch, dass der Canonical Tag keinen verbindlichen Befehl darstellt. Suchmaschinen können die Anweisungen ignorieren – insbesondere, wenn diese fehlerhaft umgesetzt sind. Zudem kann es etwa im Fall von Paginierungen und zahlreichen Filterkombinationen ratsam sein, stattdessen den Robots-Meta-Tag “noindex” zu verwenden. Denn der Canonical Tag ist nur für Seiten bestimmt, die über einen (nahezu) identischen Inhalt verfügen.

6. Füge der Domain ein SSL-Zertifikat hinzu

Ein SSL-Zertifikat sorgt für eine verschlüsselte Übertragung von Informationen zwischen Deiner Webseite und dem Server. So werden hinterlegte Daten wie Passwörter oder personenbezogene Angaben besser geschützt.

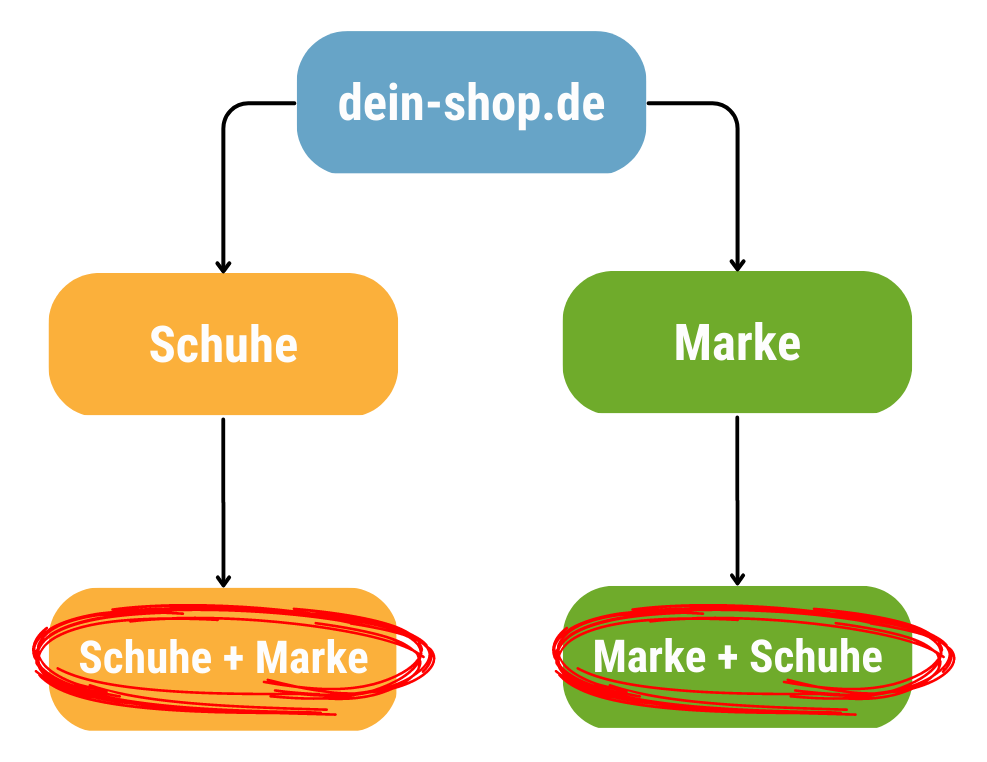

Ob die Webseite bereits ein SSL-Zertifikat besitzt, erkennst Du am Protokoll „https“ in der URL. Ist kein SSL-Zertifikat vorhanden, wird „http“ angezeigt. Eine Verbindung ohne HTTPS wird von den meisten Browsern als unsicher gekennzeichnet. Für technisches SEO ist das in mehrfacher Hinsicht relevant:

- HTTPS ist ein offizieller (wenn auch leichter) Rankingfaktor

- Es stärkt das Vertrauen von Usern.

- Eine Markierung als “unsichere Webseite” bei fehlendem SSL-Zertifikat kann die Klickrate und das Nutzerverhalten negativ beeinflussen.

7. Verbessere die Mobilfreundlichkeit der Webseite

Google bewertet Webseiten primär auf Basis der mobilen Version (Mobile-First Indexing). Die Suchmaschine betrachtet also die mobile Darstellung und bezieht die Funktionalität sowie fehlerfreie Darstellung auf Mobilgeräten in die Berechnung der Rankings ein. Für Technical SEO bedeutet das konkret, dass Du Deinen Benutzern auf mobilen Endgeräten ein optimales Nutzererlebnis bieten musst.

Um dies zu erreichen, empfiehlt Google ein Responsive Design. Dieses passt sich automatisch an unterschiedliche Bildschirmgrößen an. So kannst Du auf separate URLs für die mobile Seitenvariante verzichten und reduzierst das Risiko durch URL-Duplikate.

Alternativ kannst Du mit verschiedenen URLs für die unterschiedlichen Darstellungsvarianten arbeiten. Das ist jedoch aufwendig und erhöht das Risiko von Problemen durch doppelte Inhalte. Wenn Du dennoch derartige Varianten verwendest, kannst Du ihnen einen rel=“alternate“-Tag hinzufügen. In diesem Tag verweist dann die Desktopvariante auf die URL für mobile Endgeräte und umgekehrt.

8. Lege eine XML-Sitemap an

Das Erstellen und Optimieren von XML-Sitemaps gehört zu den Grundlagen jeder technischen Suchmaschinenoptimierung. Dabei handelt es sich um eine Liste im XML-Format mit URLs, die Suchmaschinen als relevante Startpunkte für das Crawling und die Indexierung nutzen können.

Für SEO irrelevante Seiten gehören nicht in die Sitemap. Denn findet der Crawler regelmäßig viele URLs, die nicht indexiert werden dürfen oder keinen relevanten Inhalt bieten, kann dies das Crawlbudget – also das von Suchmaschinen aufgewendete Zeitkontingent für das Crawling der Webseite – negativ beeinflussen.

Anforderungen an die XML-Sitemap:

- Kodierung nach UTF-8

- Komprimierung im Format .gz

- Referenzierung in der robots.txt

- Enthält nur kanonische URLs

- Enthält nur indexierbare und erreichbare URLs (Status Code 200)

- Listet maximal 50.000 URLs auf

- Hat eine maximale Größe von 50 MB

Du kannst die XML-Sitemap in der Google Search Console einreichen, um ein effektives Crawling zu ermöglichen. Zudem ist sie in der Regel per https://www.deine-domain.de/sitemap.xml erreichbar. Du solltest die URL der Sitemap zusätzlich auch in der robots.txt-Datei wie folgt hinterlegen:

- Sitemap: https://www.deine-domain.de/sitemap.xml

So reichst Du Deine Sitemap bei Google ein

Nachdem Du Deine XML-Sitemap erstellt hast, solltest Du Google aktiv darüber informieren. Der effektivste Weg führt über die Google Search Console:

- In der Search Console anmelden: Wähle die entsprechende Property (Deine Webseite) aus.

- Menüpunkt „Sitemaps“ aufrufen: Diesen findest Du in der linken Navigationsleiste unter dem Bereich „Indexierung“.

- URL eingeben: Gib im Feld „Neue Sitemap hinzufügen“ die URL Deiner Sitemap ein (z. B. https://www.deine-domain.de/sitemap.xml).

- Senden: Klicke auf „Senden“. Google wird die Sitemap nun regelmäßig prüfen und Dich über etwaige Fehler informieren.

9. Passe die 404-Seite an

Es kann vorkommen, dass eine URL auf eine nicht verfügbare Seite führt, etwa weil ein Link falsch gesetzt oder ein Inhalt entfernt wurde. Dann sollten Besucher nicht einfach auf einer leeren Seite landen, sondern eine hilfreiche Fehlerseite mit dem HTTP-Statuscode 404 (Not Found) vorfinden.

Eine optimierte 404-Seite sollte:

- erklären, dass der Inhalt nicht verfügbar ist,

- Navigation und Suche bereitstellen,

- passende Alternativen vorschlagen.

Das verbessert die Benutzererfahrung und reduziert im Idealfall die Zahl der Seitenabsprünge. Eine gute 404-Fehlerseite hilft also dabei, dass User länger auf der Website bleiben und auch im Falle eines Fehlers ein positives Nutzererlebnis haben. 404-Fehlerseiten sind damit nicht nur eine technische Optimierungsmaßnahme, sondern auch ein UX-Thema.

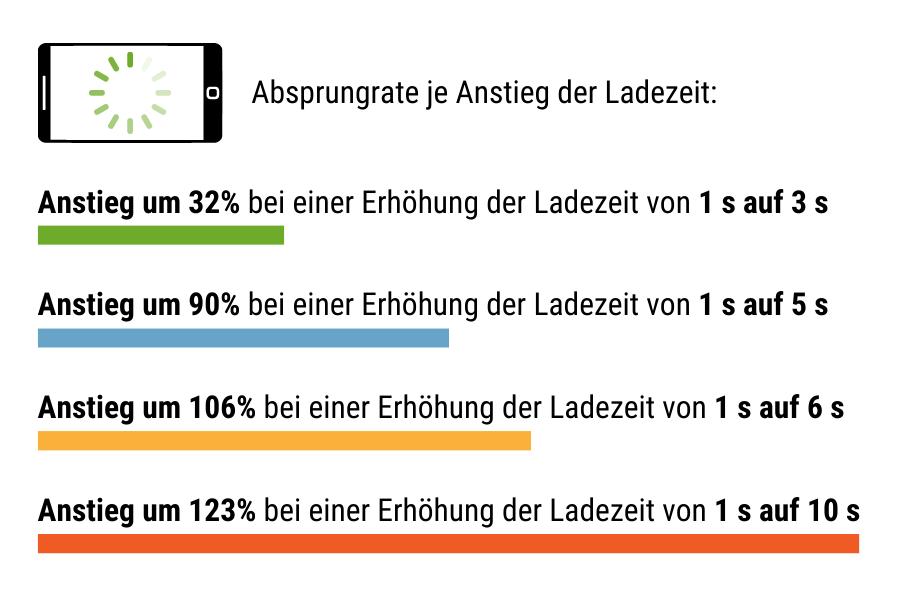

10. Sorge für schnelle Ladezeiten

Die Ladegeschwindigkeit ist ein Rankingfaktor und insbesondere für die mobile Nutzung erfolgskritisch. Lädt die Seite langsam, steigt die Wahrscheinlichkeit, dass Besucher vorzeitig abspringen, um bis zu über 120 Prozent – je nach Ladezeit. Eine langsame Seite schadet Nutzererlebnis, Suchmaschinenranking und damit der Sichtbarkeit also gleichermaßen.

Durch diese technischen SEO-Maßnahmen kannst Du die Ladezeit der Webseite verbessern:

- leistungsstarken Server nutzen

- serverseitiges Caching aktivieren

- CSS und JS reduzieren

- ungenutzte CSS- und JS-Ressourcen entfernen

- Lazy Loading verwenden

- Bilder komprimieren

- Weiterleitungsketten vermeiden

Du kannst die Ladegeschwindigkeit mit Tools wie PageSpeed Insights und der Google Search Console analysieren. Dort findest Du auch Optimierungsmöglichkeiten zu den sogenannten Core Web Vitals.

Core Web Vitals

Die Core Web Vitals sind eine Gruppe von Leistungskennzahlen von Google, die messen, wie gut sich eine Webseite aus Nutzersicht anfühlt. Im Mittelpunkt stehen dabei eine schnelle Ladezeit, eine stabile Darstellung und eine reaktionsschnelle Bedienung, insbesondere auf mobilen Geräten.

Diese Metriken identifizieren UX-Probleme und liefern konkrete Ansätze zur Performance-Optimierung. Sie werden in der Google Search Console ausgewertet, können aber beispielsweise auch mit Lighthouse oder PageSpeed Insights analysiert werden.

Die Metriken der Core Web Vitals:

- Largest Contentful Paint (LCP): Benötigte Zeit für das Laden des größten Elements im sichtbaren Bereich. Gute Werte liegen typischerweise bei ≤ 2,5 Sekunden.

- Interaction to Next Paint (INP): Misst die Reaktionszeit der Seite bei Interaktionen. Der Zielwert liegt unter 200 Millisekunden.

- Cumulative Layout Shift (CLS): Misst unerwartete Layoutverschiebungen von Inhalten während des Ladens. Der CLS-Wert sollte bei ≤ 0,1 liegen.

11. Seitentitel und Meta-Beschreibung

Die Optimierung des Title Tags und der Meta Description darf in keiner technischen Suchmaschinenoptimierung fehlen:

Title Tag: Der Title Tag ist der Seitentitel, der im Browser-Tab angezeigt wird und häufig als Überschrift eines Suchergebnisses in den SERPs erscheint. Er ist ein direkter Rankingfaktor und sollte das Fokus-Keyword möglichst an erster Stelle enthalten sowie passende Keyword-Varianten verwenden, vorausgesetzt, der natürliche Lesefluss bleibt erhalten. Als grober Richtwert hat sich eine Länge von etwa 50 bis 60 Zeichen bewährt.

Meta Description: Eine Meta Description fasst den Inhalt einer Seite in der Regel in etwa 140 bis 155 Zeichen zusammen. Sie soll zeigen, was Nutzer hinter dem Ergebnis erwartet, und sollte

- das Fokus-Keyword enthalten,

- einen konkreten Nutzen vermitteln,

- Interesse wecken,

- gegebenenfalls USPs darstellen,

- und zum Klicken motivieren.

Zusammen bilden Title Tag und Meta Description das Snippet in der Google-Suche. Auch wenn Google die Meta Description nicht als direkten Rankingfaktor nennt, hat ein überzeugendes Snippet häufig einen spürbaren Einfluss auf die Klickrate (Click-Through-Rate). Eine höhere CTR ist ein Signal dafür, dass ein Ergebnis zur Suchanfrage passt, und kann sich dadurch indirekt positiv auf Rankings und Sichtbarkeit auswirken. Da Du nur wenig Platz zur Gestaltung der Meta Tags hast, kannst Du beispielsweise den Sistrix SERP Snippet Generator nutzen, um Seitentitel und Description auf die richtige Länge zu bringen.

12. Verwende Breadcrumbs

Als Breadcrumbs werden kleine Navigationsmenüs bezeichnet, die sich oberhalb des Hauptinhalts befinden und eine schnelle Navigation zu übergeordneten Seiten ermöglichen. So ermöglichen sie es Nutzern nicht nur, sich schneller durch Deine Webseite zu bewegen, sie schaffen auch mehr Übersichtlichkeit und zeigen auf, auf welcher Ebene der URL-Hierarchie man sich gerade befindet. Zusätzlich können auch Suchmaschinen-Crawler Breadcrumbs nutzen, um den Aufbau der Webseite besser zu verstehen.

13. Pflege strukturierte Daten ein

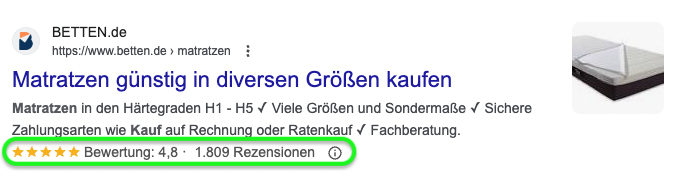

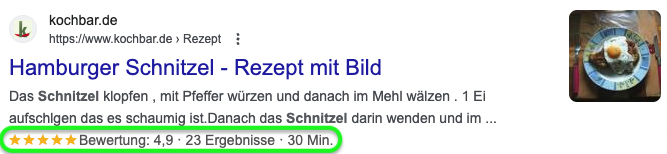

Bei strukturierten Daten handelt es sich um ein standardisiertes Markup nach schema.org, das Suchmaschinen und KI-Sprachmodellen hilft, Seiteninhalte besser zu verstehen. So können etwa Produktseiten mit speziellen Schemata ausgezeichnet werden. Auf diese Weise können Google und AI-Sprachmodelle wie ChatGPT oder Gemini Details wie Preise oder Bewertungen direkt in den Suchergebnissen anzeigen – und das kann sich positiv auf die Klickrate auswirken.

Daher ist die Einbindung strukturierter Daten je nach Seitentyp eine wichtige Maßnahme im technischen SEO, auch wenn es sich dabei nicht um einen direkten Rankingfaktor handelt.

Je nach Seitentyp, Inhalt und Branche stehen Dir unterschiedliche Schemata für strukturierte Daten zur Verfügung. Häufig genutzte Schema-Markups sind zum Beispiel:

- Organization: Für Unternehmensdaten wie Name, Logo, Kontaktinformationen und Social-Profile.

- WebSite: Zur Beschreibung der Website, häufig zusammen mit einer Suchfunktion (Sitelinks Search Box).

- LocalBusiness (z. B. Restaurant, Store, MedicalBusiness): Für lokal tätige Unternehmen, etwa mit Adresse, Öffnungszeiten und Telefonnummer.

- Product: Für Produktseiten (z. B. Preis, Verfügbarkeit, Zustand).

- Offer: Häufig als Bestandteil von Product, um Preis- und Verfügbarkeitsangaben zu strukturieren.

- AggregateRating / Review: Für Bewertungen und Rezensionen (wenn diese auf der Seite tatsächlich vorhanden sind).

- BreadcrumbList: Für Breadcrumbs, damit Google die Seitenhierarchie besser verstehen und ggf. in den SERPs darstellen kann.

- FAQPage: Für FAQ-Bereiche, wenn Fragen und Antworten im sichtbaren Content stehen.

- Article (z. B. BlogPosting, NewsArticle): Für redaktionelle Inhalte wie Blogartikel oder News.

- VideoObject: Für Videoseiten (z. B. Titel, Beschreibung, Thumbnail, Upload-Datum).

- Event: Für Veranstaltungen (Datum, Ort, Ticketinfos), wenn relevant.

Google empfiehlt zur Einbindung das Format JSON-LD, das als zusammenhängender Code-Block (Script) in den Quelltext integriert werden kann.

14. Optimiere die Struktur von Texten

Die Zeiten von Texten, in denen sich Keyword an Keyword reiht, sind vorbei. Um erfolgreich zu sein, müssen Texte Mehrwert bieten und gut strukturiert sein. Das verbessert einerseits die Benutzererfahrung, erleichtert es aber auch Suchmaschinen und künstlicher Intelligenz, Inhalte zu verarbeiten.

Diese Maßnahmen helfen Dir, verständliche Texte mit Mehrwert zu erstellen:

- Verwende Zwischenüberschriften mit Heading-Tags:

- <h1>: Seitenüberschrift

- <h2>: Kapitelüberschriften

- <h3>: Unterüberschriften

- Kurze Sätze und Absätze

- Wichtige Begriffe gezielt fett markieren

- Keywords sinnvoll in Überschriften und Fließtext verteilen

- Interne Verlinkung auf weiterführende Inhalte

- Multimedial arbeiten (Bilder, Videos)

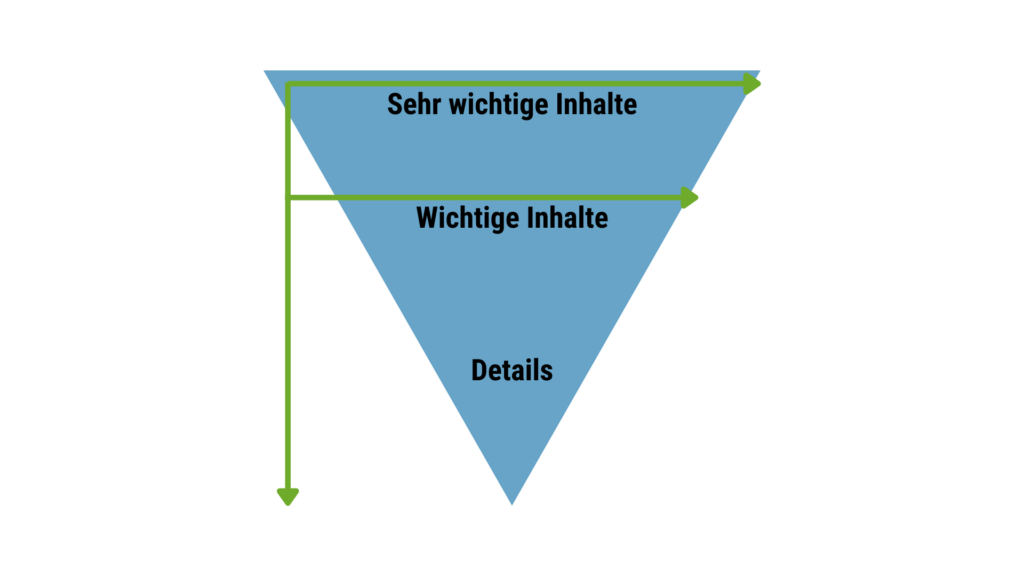

Bei der inhaltlichen Strukturierung hilft das Prinzip der inversen Pyramide:

- Wichtige Informationen zuerst, Details später

- Der erste Absatz steht für die gesamte Seite und enthält die wichtigsten Keywords

- Der erste Absatz des jeweiligen Kapitels steht für das gesamte Kapitel

- Der erste Satz eines Absatzes steht für den gesamten Absatz

Diese Struktur entspricht dem typischen Leseverhalten (F- oder Z-Pattern), bei dem Nutzer Texte meist nur scannen. Die größte Aufmerksamkeit bei diesen Blickmustern erhalten die Inhalte, die sich am Seitenanfang befinden. Finden Nutzer hier nicht sofort den erwarteten Inhalt, verlassen sie die Seite meist umgehend.

15. Nutze Alt-Tags für Bilder

Alt-Texte (Alternativtexte) beschreiben den Bildinhalt für den Fall, dass die Datei nicht geladen werden kann, und werden von Screenreadern für Personen mit eingeschränkter Sicht vorgelesen. Damit dienen sie der Barrierefreiheit der Webseite. Zusätzlich helfen Alt-Tags, die Sichtbarkeit Deiner Bilder in der Google-Bildersuche zu verbessern.

So optimierst Du Alt-Tags:

- Vermeide Keyword-Stuffing

- Beschreibe den Bildinhalt in wenigen Worten

- Nutze das Fokus-Keyword, wenn es passt

16. Weiterleitungen (Redirects) im technischen SEO

Weiterleitungen sind ein zentraler Bestandteil des technischen SEO. Sie steuern, was passiert, wenn sich eine URL ändert oder wenn Inhalte zusammengelegt werden. Richtig eingesetzt können Redirects ein bestehendes Suchmaschinenranking schützen und dafür sorgen, dass Besucher und Suchmaschinen ohne Umwege auf die passende Zielseite gelangen, auch wenn der Inhalt nun unter einer anderen URL zu finden ist.

Wann sind Weiterleitungen besonders wichtig?

- Bei einem Relaunch oder einem CMS-Wechsel, wenn sich eine URL-Struktur verändert.

- Beim Zusammenführen von Inhalten (z. B. aus mehreren Beiträgen wird ein besserer Guide).

- Beim Entfernen von Seiten (z. B. auslaufende Produkte, veraltete Landingpages).

- Bei einer Konsolidierung von Duplicate Content (z. B. Varianten-URLs, alte Kampagnen-URLs).

- Bei einer Umstellung von http auf https.

Welche Redirect-Typen sind relevant?

- 301 (permanent): Der Standard im SEO, wenn eine URL dauerhaft ersetzt wird. Google kann die neue URL übernehmen und Rankingsignale auf die Zielseite übertragen.

- 302 / 307 (temporär): Für vorübergehende Umleitungen (z. B. Wartung der Webseite oder A/B-Tests). Für dauerhafte Änderungen sind sie meist nicht die beste Wahl.

- Meta Refresh / JavaScript-Redirects: Aus SEO-Sicht sind derartige Weiterleitungen nicht zu empfehlen, da sie mitunter nicht vom Crawler berücksichtigt werden.

Best Practices, damit Deine Weiterleitungen wirklich helfen

- Immer thematisch passend weiterleiten: Alte URL → die inhaltlich nächste, beste Zielseite. Nicht pauschal alles auf die Startseite schicken (das wirkt oft wie ein Soft-404).

- Keine Redirect-Ketten bauen: A → B → C kostet Ladezeit, erschwert Crawling und kann Signale verwässern. Ziel: A → C.

- Interne Links aktualisieren: Interne Links sollten direkt auf die Ziel-URL zeigen, nicht auf eine Weiterleitung.

- Statuscodes und Zielseiten prüfen: Zielseiten sollten idealerweise einen 200-Status liefern (nicht erneut weiterleiten, nicht 404).

- Monitoring nach Änderungen: Nach einem Relaunch Redirects testen, Crawl-Fehler und Indexierungsstatus in der Search Console beobachten und zeitnah nachbessern.

Was ist mit 404-Fehlerseiten?

Nicht jede entfernte Seite benötigt eine Weiterleitung. Wenn es keinen sinnvollen Ersatz gibt, ist eine saubere 404 (Not found) oder 410 (Gone) oft besser, als Nutzer und Suchmaschinen auf irrelevante Seiten umzuleiten.

17. JavaScript-Rendering und Crawlability

Moderne Websites nutzen häufig JavaScript-Frameworks (wie React, Angular oder Vue), um interaktive Inhalte zu erstellen. Für Suchmaschinen stellt dies jedoch eine Herausforderung dar: Während klassisches HTML direkt beim ersten Aufruf gelesen werden kann, muss JavaScript erst ausgeführt werden, um den Inhalt sichtbar zu machen. Dies geschieht im sogenannten Rendering-Prozess:

- Erstes Crawling: Der Bot erfasst das unverarbeitete HTML.

- Rendering: Sobald Ressourcen frei sind, rendert der Googlebot die Seite wie ein Browser und indexiert erst dann die dynamisch generierten Inhalte.

Suchmaschinen wie Google können JavaScript lesen. Das Ausführen von JS-Ressourcen kostet jedoch Zeit und erfolgt nicht immer. Relevante Inhalte sollten daher immer ohne JavaScript gerendert werden.

Rendering-Verfahren im Vergleich

Je nachdem, wie die Inhalte bereitgestellt werden, unterscheidet man verschiedene Ansätze, die großen Einfluss auf die SEO-Performance haben können:

- Client-Side Rendering (CSR): Der Browser (oder Crawler) erhält ein fast leeres HTML-Dokument und muss alle Inhalte selbst per JavaScript aufbauen. Dies belastet das Render-Budget von Google und führt oft zu einer verzögerten Indexierung.

- Server-Side Rendering (SSR): Der Server generiert das fertige HTML und sendet es direkt an den Bot. Dies ist die sicherste Methode für eine sofortige Indexierung, da der Crawler sofort alle Inhalte sieht.

- Dynamic Rendering: Hier erkennt der Server anhand des Crawler-Typs (User Agent), wer die Seite aufruft. Nutzer erhalten die JavaScript-Version (CSR), während Suchmaschinen-Bots eine vorgerenderte HTML-Version erhalten. Dies eignet sich etwa als Übergangslösung, bis alle wichtigen Inhalte vollständig per HTML geladen werden können.

- Static Site Generation (SSG): Inhalte werden bereits beim Erstellen der Website in statische HTML-Dateien umgewandelt. Das ermöglicht schnelle Ladezeiten und eine optimale Crawlbarkeit.

Häufige Fehler bei der Verwendung von JavaScript

- Blockierte Ressourcen: Wenn JS-Dateien per robots.txt gesperrt sind, kann Google die Seite nicht korrekt rendern.

- Timeouts: Benötigt ein Skript zu lange zum Laden, bricht der Renderer ab und sieht möglicherweise nur eine unvollständige Seite.

- Veraltete Schnittstellen: Achte darauf, dass Dein Code mit dem aktuellen „Evergreen-Googlebot“ kompatibel ist und nutze moderne Web-Standards, wie aktuelles JavaScript, CSS und HTML5.

18. Hreflang für internationale Webseiten

Wenn Du Deine Website in mehreren Sprachen oder für verschiedene Regionen (z. B. Deutschland, Österreich und die Schweiz) anbietest, ist die korrekte Implementierung von hreflang-Attributen entscheidend. Diese Tags helfen Google zu verstehen, welche Sprachversion für welchen Nutzer in den Suchergebnissen angezeigt werden soll.

Ohne hreflang besteht das Risiko, dass Google die verschiedenen Sprachversionen als Duplicate Content einstuft oder dem Nutzer die falsche Version (z. B. die deutsche Seite für einen Schweizer Nutzer) ausspielt.

Die wichtigsten Regeln für die Implementierung:

- Bidirektionalität (Rückbezug): Dies ist die häufigste Fehlerquelle. Wenn Seite A auf die englische Version Seite B verweist, muss Seite B zwingend auch auf Seite A zurückverweisen. Fehlt dieser Rückbezug, ignoriert Google die Anweisung.

- Selbstreferenzierung: Jede Seite muss auch ein hreflang-Tag enthalten, das auf sich selbst verweist.

- ISO-Codes nutzen: Verwende immer die korrekten Sprachcodes (ISO 639-1) und optional Regionscodes (ISO 3166-1 Alpha 2), z. B. de-AT für Deutsch in Österreich.

- x-default: Verwende diesen Tag für Seiten, die keiner spezifischen Sprache zugeordnet sind (z. B. eine globale Startseite zur Sprachauswahl). Er dient als „Auffangbecken“ für alle Nutzer, deren Sprache nicht explizit abgedeckt ist.

Wo werden hreflang-Tags eingebunden?

Es gibt drei technische Wege, die Signale zu übermitteln:

- Im HTML-Head: Direkt im <head>-Bereich jeder einzelnen Seite (am häufigsten genutzt).

- In der XML-Sitemap: Besonders bei sehr großen Websites vorteilhaft, um den Quellcode der Seite schlank zu halten.

- Im HTTP-Header: Vor allem für Nicht-HTML-Dateien wie PDFs wichtig.

Durch eine saubere hreflang-Struktur stellst Du sicher, dass Nutzer weltweit immer die für sie relevanteste Version Deiner Website finden, was die Absprungrate senkt und die Conversion-Rate in internationalen Märkten steigert.

Die korrekte Syntax im HTML-Head

Angenommen, Du hast eine Seite über „SEO-Beratung“ in drei Versionen: Deutsch (Hauptseite), Deutsch für Österreich und Englisch für die USA. So müssten die Tags im <head> jeder dieser drei Seiten aussehen:

- <link rel=“alternate“ hreflang=“de“ href=“https://example.com/de/seo-beratung/“ />

- <link rel=“alternate“ hreflang=“de-at“ href=“https://example.com/at/seo-beratung/“ />

- <link rel=“alternate“ hreflang=“en-us“ href=“https://example.com/us/seo-consulting/“ />

- <link rel=“alternate“ hreflang=“x-default“ href=“https://example.com/en/seo-consulting/“ />

Deine Checkliste für technisches SEO

- Kategorie- und URL-Struktur optimieren

- Duplicate Content prüfen und bereinigen

- Crawlbarkeit wichtiger Inhalte prüfen

- Relevante Seiten sind indexierbar, irrelevante Inhalte nicht

- SSL-Zertifikat hinzufügen

- Mobilfreundlichkeit sicherstellen (Responsive Design)

- Canonical Tags prüfen und implementieren

- XML-Sitemap erstellen, in robots.txt und Search Console hinterlegen

- 404-Fehlerseite optimieren

- Ladegeschwindigkeit und Core Web Vitals verbessern

- Title-Tag und Meta-Description als Metadaten optimieren

- Breadcrumbs implementieren

- Strukturierte Daten einpflegen

- Texte gemäß inverser Pyramide und mit H-Tags formatieren

- Alt-Tags nutzen

- Weiterleitungen mit korrektem Status-Code

- Alle relevanten Inhalte werden ohne JavaScript ausgeführt

- Hreflang-Tags für Sprach- und Ländervarianten von internationalen Seiten

Technisches SEO für nachhaltiges Wachstum mit Digitaleffects

Technisches SEO ist das Fundament jeder erfolgreichen SEO-Strategie. Denn selbst der beste Content bringt wenig, wenn Suchmaschinen und KI-Systeme Inhalte nicht zuverlässig crawlen, verstehen und indexieren können oder wenn Nutzer wegen langsamer Ladezeiten, fehlerhafter Darstellungen oder technischer Hürden abspringen. Wer langfristig stabile Rankings, eine höhere Sichtbarkeit und mehr Umsatz erreichen will, benötigt daher eine technisch saubere Webseite, die kontinuierlich überwacht und weiterentwickelt wird.

Wir unterstützen Dich gerne als starker Ansprechpartner für technische Suchmaschinenoptimierung: Als Performance-SEO-Agentur aus Berlin setzen wir auf ein systematisches Vorgehen, das SEO-Maßnahmen mit messbaren Geschäftszielen verbindet. Unter anderem mit technischem SEO machen wir Deine Website gezielt fit für Google und generative KI – mit dem Ziel, nicht nur Sichtbarkeit zu erzielen, sondern vor allem Leads, Umsatz und Marktanteile zu steigern. Überzeuge Dich doch einfach selbst in einer kostenlosen SEO-Strategie Session.

Gratis SEO-Strategie Session sichern

1. Session

anfragen

2. Roadmap

erhalten

3.Marktanteile

erobern

Frage jetzt Deine persönliche Strategie-Session in einem 1-on-1-Videocall mit Christian B. Schmidt an. Statt allgemeiner „SEO-Tipps“ bekommst Du Deine individuelle Challenger Roadmap, um neue Marktanteile zu erobern.

Limitiert auf 10 Sessions pro Monat und nur für Hidden Champions mit Wachstumszielen.

Christian optimiert seit 1998 Websites und berät Unternehmen seit 2005 im Online Marketing. Als Geschäftsführer der SEO-Agentur verantwortet er Marketing und Vertrieb. Gerne beantwortet er Fragen und sendet weitere Infos zu. Mehr über CBS